在數字化轉型浪潮中,企業的核心業務系統正面臨前所未有的挑戰。一方面,傳統單體或臃腫的業務系統難以應對用戶量的激增與業務的快速迭代,導致性能瓶頸和運維成本高昂,“核心業務瘦身”已成為提升敏捷性和競爭力的關鍵舉措。另一方面,在線數據處理與交易處理業務(OLTP)每時每刻都在產生海量數據,如何實時、準確地處理這些數據,并將其轉化為業務洞察,成為制勝未來的核心能力。本文將手把手帶你探索,如何在核心業務“瘦身”重構的背景下,構建一個穩定、高效、可擴展的海量數據實時處理架構。

第一部分:為何“核心業務瘦身”需要實時處理架構護航?

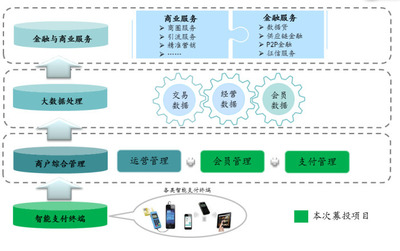

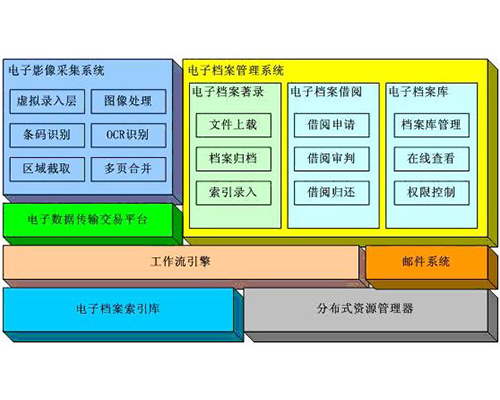

傳統的“巨石型”業務系統通常將數據存儲、業務邏輯、事務處理高度耦合。這不僅使系統變得笨重,難以擴展,更讓實時數據分析成為奢望。“瘦身”的本質是微服務化、服務解耦和領域驅動設計,旨在構建一個個輕量、自治、專注的業務服務。

業務拆分后,數據卻變得更加分散。訂單、用戶、庫存、支付等數據散落在各個微服務數據庫中。此時,業務對全局數據的實時洞察需求反而更加強烈:

- 實時風控:在交易發生的毫秒間識別欺詐行為。

- 實時監控:動態追蹤業務大盤、系統健康度與用戶行為。

- 實時推薦:根據用戶當前操作實時推送個性化內容。

- 實時報表:管理層需要看到分鐘級甚至秒級的業務數據。

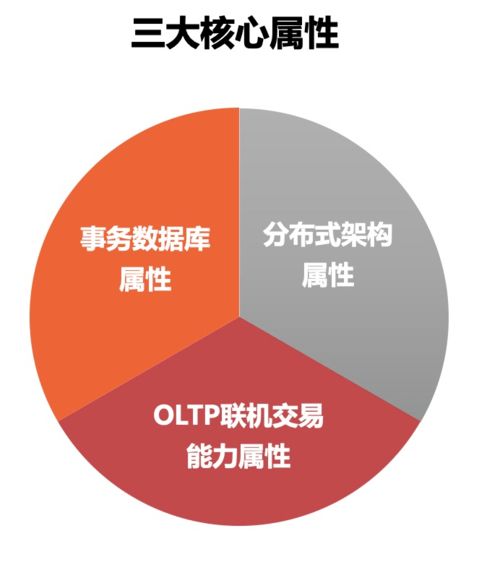

因此,一個獨立于核心交易鏈路之外的海量數據實時處理架構,就成為承接“瘦身”后核心業務數據、賦能實時決策的“神經系統”。它確保在線交易處理(OLTP)系統輕裝上陣、專注事務,同時將數據變化實時同步、加工、分析,形成閉環價值。

第二部分:手把手搭建海量數據實時處理架構核心四層

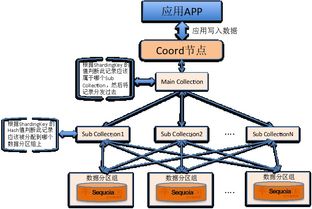

一個典型的實時處理架構可分為四層:數據采集、數據傳輸、實時計算與數據存儲、應用服務。

第一層:實時數據采集 – “感官網絡”

目標是低侵入、無阻塞地捕獲核心業務系統的每一條數據變更。

- 首選方案:變更數據捕獲(CDC)。通過監聽數據庫的Binlog(如MySQL)或WAL(如PostgreSQL),將數據的插入、更新、刪除事件實時流式化。工具如 Debezium,它能將數據庫變更轉換為事件流,對業務系統近乎零影響。

- 補充方案:應用日志埋點。對于無法通過CDC捕獲的業務事件(如某些業務狀態變更),可通過結構化日志(如JSON格式)輸出,再由 Flume 或 Filebeat 收集至消息隊列。

第二層:數據傳輸與緩沖 – “高速公路”

承接高吞吐的數據流,并解耦采集與計算過程,起到削峰填谷的作用。

- 消息隊列(Kafka)是此層的基石。它將CDC或日志產生的事件序列化為Topic,其高吞吐、持久化、分區和容錯特性完美契合實時流需求。建議按業務域或數據主題(如

order<em>events,user</em>events)劃分Topic,便于管理。

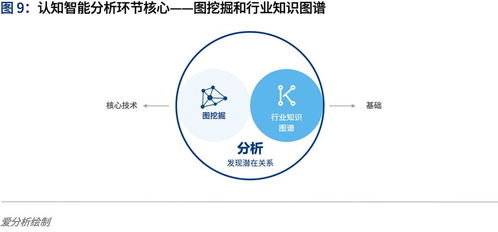

第三層:實時計算引擎 – “智慧大腦”

這是架構的核心,負責對數據流進行實時轉換、聚合、分析與建模。

- 流處理框架選型:

- Apache Flink:當前實時處理領域的首選。它提供了精確一次(Exactly-Once)語義、豐富的API(DataStream API/SQL)、強大的狀態管理和窗口計算能力,非常適合做復雜事件處理(CEP)、實時聚合(如每分鐘GMV)和流批一體作業。

- Apache Spark Streaming:基于微批處理(Micro-Batch),適合對延遲要求稍寬松(秒級)但需要與批處理共享代碼的場景。

- 典型計算任務:

- ETL:清洗、標準化來自不同業務的數據。

- 實時聚合:計算實時銷售額、熱門商品、用戶在線數等。

- 流式關聯:將訂單流與用戶流、商品流實時關聯,生成寬表。

- 異常檢測:基于規則或模型實時識別交易異常。

第四層:數據存儲與服務 – “決策寶庫”

經過計算處理的結果需要存儲并提供低延遲查詢服務。

- 實時OLAP數據庫:用于即席查詢與多維分析。

- ClickHouse:以極致的查詢速度著稱,適合做大寬表的實時聚合分析。

- Apache Doris:兼容MySQL協議,支持高并發點查和批量導入,使用更友好。

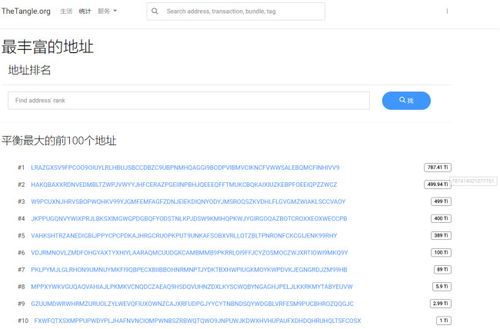

- 高速KV存儲:用于實時查詢單個實體的最新狀態,如用戶畫像、商品庫存。

- Redis:內存存儲,延遲極低。

- TiKV:分布式、強一致的KV存儲,容量更大。

- 數據服務層:通過統一的API網關或RPC服務,將存儲在OLAP或KV中的數據封裝成接口,提供給前端應用、風控系統或推薦系統調用。

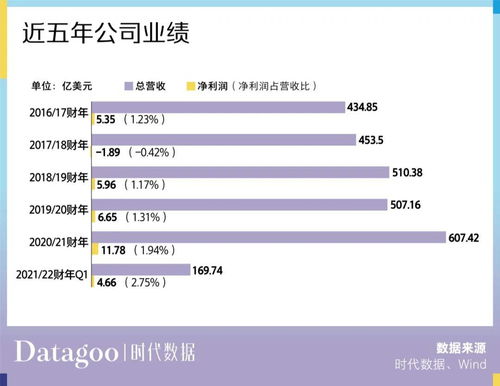

第三部分:架構實踐:以“實時交易大盤”為例

假設我們有一個已“瘦身”的電商微服務集群(訂單服務、用戶服務、商品服務)。現在需要搭建一個實時交易數據大屏。

- 數據采集:在訂單、支付服務的數據庫上部署Debezium Connector,捕獲訂單創建、支付成功等核心事件,寫入Kafka的

order_cdcTopic。

2. 實時計算:使用Flink任務消費 order<em>cdc 數據流。

- 通過Flink SQL,對支付成功事件流按 1分鐘 的滾動窗口進行聚合:

`sql

SELECT

DATEFORMAT(paytime, 'yyyy-MM-dd HH:mm') as minute,

COUNT(orderid) as ordercount,

SUM(amount) as gmv

FROM orderstream

WHERE status = 'PAIDSUCCESS'

GROUP BY TUMBLE(paytime, INTERVAL '1' MINUTE), DATEFORMAT(paytime, 'yyyy-MM-dd HH:mm')

`

- 將聚合結果(每分鐘訂單量、GMV)實時寫入ClickHouse的

real<em>time</em>dashboard表。

- 數據服務與展示:大屏后端服務直接查詢ClickHouse,獲取最近幾小時的分鐘級聚合數據,通過WebSocket或HTTP API推送到前端大屏實時刷新。

第四部分:關鍵挑戰與最佳實踐

- 數據一致性:確保從業務數據庫到最終數據視圖的端到端一致性。利用Flink的Exactly-Once語義和Kafka事務生產者。

- 容錯與高可用:所有組件(Kafka, Flink, ClickHouse)均需集群化部署。Flink需配置Checkpoint和Savepoint,實現任務狀態持久化和故障恢復。

- 資源隔離:實時處理集群應與核心OLTP業務在物理或邏輯資源上隔離,避免相互干擾。

- 架構演進:初期可從核心業務最重要的1-2個數據流開始,快速驗證價值,再逐步擴展。

###

核心業務“瘦身”與海量數據實時處理架構的建設,是一體兩面、相輔相成的戰略舉措。“瘦身”讓業務更敏捷,而實時處理架構則讓數據產生即時的智慧。通過CDC、Kafka、Flink、ClickHouse等現代數據棧的有機組合,企業能夠構建起從在線交易到實時決策的“數據高速公路”。這不僅是對當前在線數據處理與交易處理業務的強大賦能,更是面向未來數據驅動商業模式的堅實奠基。現在,就從你最關心的一個業務流開始,動手搭建屬于你自己的實時處理架構吧!